Avec le développement de la technologie, plus particulièrement de l’intelligence artificielle, la robotique prend de l’ampleur dans la société humaine. Elle doit donc être soigneusement encadrée par des règles d’éthiques pour prévenir tout dérapage. C’est dans ce sens qu’un colloque a été organisé cette semaine à l’Académie pontificale des sciences du Vatican.

Sur la base des premières règles fixées par l’écrivain Isaac Asimov

Aujourd’hui, la robotique ne relève plus de la science-fiction comme beaucoup le pensaient il y a encore quelques décennies. Les robots sont de plus en plus présents dans nos sociétés, grâce au développement de l’intelligence artificielle. Les machines nous rendent d’énormes services, notamment dans le domaine de l’assistance, de la médecine, du sexe et du militaire. Au regard de leur ampleur et de leur usage de plus en plus « démocratique », il apparait urgent d’édicter quelques lois afin de réguler le secteur.

C’est dans ce cadre qu’un panel d’experts en intelligence a organisé un colloque, cette semaine à l’Académie pontificale des sciences du Vatican. Partant des trois règles fixées en 1942 par l’auteur de science-fiction Isaac Asimov (la première recommande qu’un robot ne puisse porter atteinte à un être humain), les experts réunis au Vatican en ont formulées quatre autres, plus juridiques.

Les quatre lois fondamentales qui doivent guider la robotique

La première stipule que les robots « doivent compléter et non remplacer les professionnels ». Or actuellement cette pratique est sérieusement mise à l’étude dans l’industrie et la médecine (seuls les métiers créatifs y échappent, mais pour combien de temps ?). C’est la rentabilité qui le veut, nous dit-on…Pour le juriste américain Frank Pasquale, expert en intelligence artificielle, « Plutôt que d’avoir un médecin-robot, il faut espérer être soigné par un médecin qui comprend comment fonctionne l’IA, qui en tire de bons conseils, et qui en fin de compte décide ce qu’il doit faire ou ne pas faire ».

La seconde règle préconise d’arrêter la course aux armements robotiques, quelque « noble » que puisse être le but car « C’est déprimant et c’est aussi de l’argent jeté par les fenêtres. », estime le professeur de droit à l’Université américaine du Maryland (est). Aussi attire-t-il l’attention sur l’imprévisibilité des machines. « Vous construisez un robot qui peut dire si mon robot prévoit que votre robot va l’attaquer et ainsi de suite, c’est sans fin… », et patatras, voilà les dégâts.

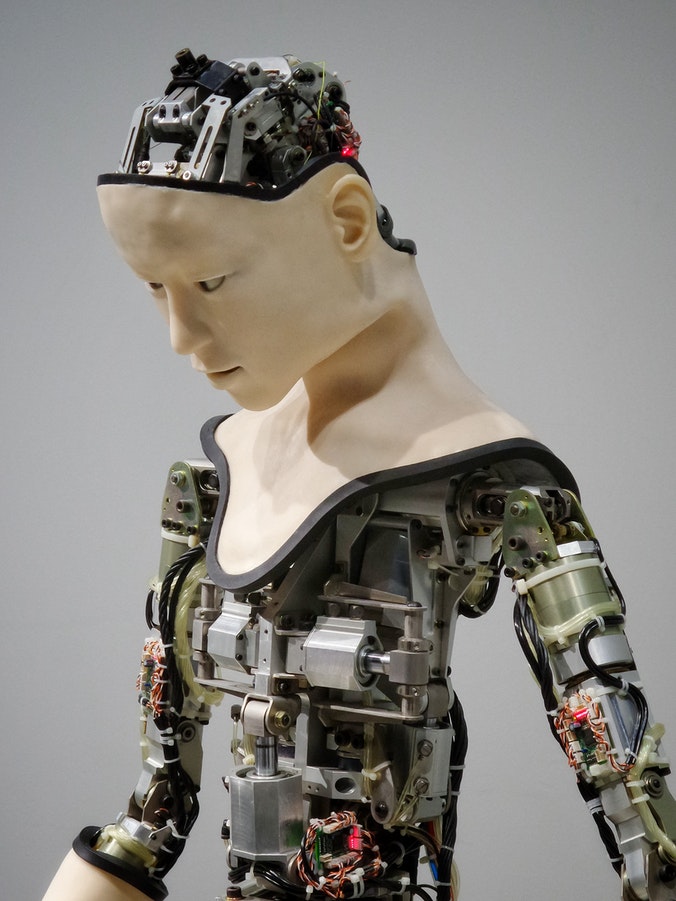

La troisième loi défend de créer des robots ou des intelligences artificielles humanoïdes capables de poser certaines actions délicates à votre place. Il y a par exemple l’assistant Duplex de Google qui peut réserver une table au restaurant pour vous. La plus part des gens perçoivent cette machine comme une dangereuse contrefaçon de l’être humain. Pour les experts, ces robots humanoïdes ne sont tolérables que dans certains cas comme pour les soins médicaux ou le sexe.

Enfin, la quatrième règle exige que tout robot ou intelligence artificielle soit dépendant ou appartienne à une personne ou un groupe de personnes. C’est une question de sécurité et surtout de bon sens car « nous savons comment punir les humains mais pas les machines », fait remarquer Frank Pasquale.